Tres formas de construir chat grupal con IA: Por qué elegimos el camino difícil

La pregunta que lo inició todo

"¿Por qué cada personaje no puede tener su propia burbuja de mensaje, como otras apps?"

Recibimos esta pregunta mucho. Y honestamente, es una gran pregunta. La mayoría de las apps de chat muestran mensajes como burbujas separadas - una por persona. Entonces, ¿por qué nuestro chat grupal combina múltiples respuestas de personajes en un solo mensaje?

La respuesta no es pereza ni descuido. Es una elección de ingeniería deliberada nacida de meses de experimentación con tres enfoques fundamentalmente diferentes para conversaciones grupales de IA.

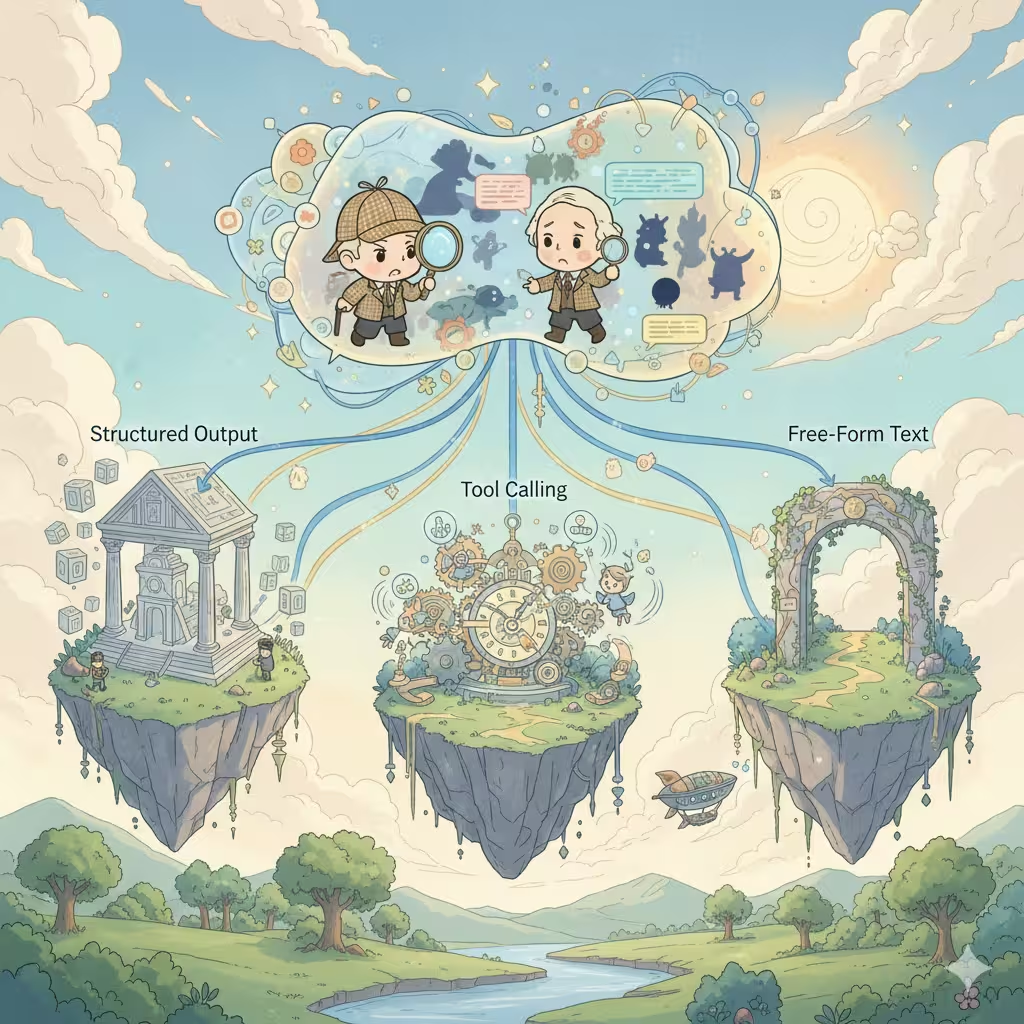

Las tres arquitecturas

Al construir conversaciones de IA con múltiples personajes, cada plataforma enfrenta la misma decisión. Hay exactamente tres formas de hacerlo, cada una con profundas implicaciones para el costo, la calidad y la experiencia del usuario.

1. Salida estructurada (Arrays JSON)

El enfoque más común en la industria. Le pides a la IA que devuelva un array JSON donde cada elemento representa la respuesta de un personaje:

[

{

"speaker": "Sherlock",

"emotion": "intrigado",

"content": "Fascinante. El patrón del barro sugiere..."

},

{

"speaker": "Watson",

"emotion": "confundido",

"content": "Holmes, ¿qué quiere decir?"

}

]El atractivo:

- Una llamada API, un consumo de créditos

- Fácil de parsear y renderizar como burbujas de mensaje separadas

- Puede incluir metadatos ricos (emociones, acciones, descripciones de escena)

- Perfecto para generar sugerencias de respuesta del usuario

La realidad:

- Solo los modelos premium caros (Claude, GPT-4) soportan salida estructurada de forma confiable - la mayoría de los modelos asequibles tienen problemas con el formateo JSON consistente

- Los errores de formato rompen toda la respuesta

- Las instrucciones JSON consumen tokens, reduciendo el espacio creativo

- Los modelos se sienten "restringidos" - la creatividad a menudo sufre

- Las restricciones de contenido se vuelven más estrictas: el modo de salida estructurada a menudo activa filtrado de contenido más agresivo, haciendo que los escenarios de roleplay maduros o atrevidos tengan más probabilidad de fallar

- Contaminación del contexto: tu historial de conversación se llena de estructuras JSON

- Complejidad del manejo de errores: ¿qué pasa cuando el parseo falla a mitad del streaming?

La mayoría de las plataformas de personajes de terceros usan este enfoque. Funciona, pero las restricciones son reales.

2. Llamadas a herramientas (Modo Agente)

El enfoque más "inteligente". La IA decide qué personaje debe hablar a continuación, llama a una herramienta para indicarlo, luego genera la respuesta de ese personaje. Repite hasta que la escena esté completa.

IA piensa: "Watson debería reaccionar a esta revelación"

→ llama herramienta: next_speaker("Watson")

→ genera respuesta de Watson

→ IA piensa: "Ahora Sherlock intervendría"

→ llama herramienta: next_speaker("Sherlock")

→ genera respuesta de Sherlock

...

El atractivo:

- Flujo de conversación más natural

- La IA tiene control creativo total sobre el ritmo de la escena

- Cada respuesta de personaje obtiene calidad de generación dedicada

- Naturalmente produce mensajes separados por personaje

La realidad:

- Múltiples llamadas API = múltiples cargos de créditos

- La latencia se acumula: N personajes = N viajes de ida y vuelta

- Solo los modelos de alta gama (Claude, GPT-4) manejan las llamadas a herramientas de forma confiable - los modelos más baratos a menudo fallan o alucinan llamadas a herramientas

- Gestión de estado compleja entre llamadas

- Riesgo de bucles infinitos o terminación inesperada

- Pesadillas de depuración: los problemas son difíciles de reproducir

Esta es la "arquitectura de ensueño" que se ve hermosa en papel pero crea dolores de cabeza operacionales a escala.

3. Salida de texto libre (Nuestra elección actual)

El enfoque más simple. Pide a la IA que escriba la escena naturalmente, dejándola decidir cómo presentar múltiples personajes en prosa fluida:

Sherlock se inclinó hacia adelante, ojos agudos. "Fascinante. El

patrón del barro sugiere que nuestro sospechoso vino del lado este."

Watson frunció el ceño. "Holmes, ¿qué quiere decir? Es solo barro."

"¿Solo barro?" Sherlock sonrió. "Mi querido Watson, no existe

tal cosa como 'solo' nada."

El atractivo:

- Funciona con cada modelo de IA, sin necesidad de características especiales

- Máxima libertad creativa - la IA escribe naturalmente

- Contexto limpio: el historial de conversación se lee como una novela

- Excelente experiencia de streaming

- Una llamada, costos predecibles

- Lo más simple de implementar y mantener

La realidad:

- Todos los personajes en un bloque de mensaje

- No se puede regenerar fácilmente la respuesta de un solo personaje

- La flexibilidad de UI es limitada

- Los usuarios que esperan burbujas estilo chat pueden sentirse confundidos

Aprendimos esto por las malas

Aquí hay algo que no hemos compartido públicamente antes: nuestra primera versión del chat grupal usaba llamadas a herramientas.

Creíamos en la "arquitectura de ensueño". La IA decidiendo quién habla a continuación, cada personaje obteniendo generación dedicada, hermosas burbujas de mensaje separadas. Era elegante. Era inteligente. También fue un desastre en producción.

Los usuarios experimentaron costos impredecibles - a veces 3x lo que esperaban para la misma conversación. Los tiempos de respuesta variaban enormemente dependiendo de cuántos personajes la IA decidía involucrar. Los modelos más baratos alucinaban llamadas a herramientas o se quedaban atrapados en bucles. Nuestros logs de errores se llenaron de casos extremos que nunca anticipamos.

Después de meses de parches y soluciones alternativas, tomamos la difícil decisión de reconstruir desde cero con salida de texto libre. Se sintió como un paso atrás. Pero a veces la solución "menos inteligente" es la elección más inteligente.

Por qué tomamos esta decisión

Después de probar los tres enfoques extensivamente - y enviar uno a producción - elegimos salida de texto libre para el chat grupal. Aquí está el porqué:

Estabilidad sobre características - La salida estructurada falla impredeciblemente. Cuando tu chat grupal se rompe a mitad de conversación, a los usuarios ya no les importan las burbujas separadas - solo quieren que funcione. El texto libre nunca falla por problemas de formato.

Calidad sobre cantidad - Los formatos restringidos reducen sutilmente la creatividad de la IA. Cuando comparamos las salidas, el texto libre consistentemente produjo interacciones de personajes más vívidas y naturales. La IA podía enfocarse en contar historias en lugar de sintaxis JSON.

Predictibilidad de costos - El modo agente cobra por personaje por respuesta. Una escena de cinco personajes podría costar 5-10x más de lo esperado. Los usuarios merecen precios predecibles.

Compatibilidad universal - Soportamos múltiples modelos de IA. No todos soportan salida estructurada o llamadas a herramientas igual de bien. El texto libre funciona en todas partes, dando a los usuarios más opciones de modelos.

El compromiso que aceptamos

Sí, sacrificamos la experiencia de "una burbuja por personaje". Pero ganamos:

- Confiabilidad sólida como roca

- Mejor calidad creativa

- Costos predecibles

- Soporte de modelos más amplio

- Historial de conversación más limpio

Para roleplay grupal, donde la inmersión es lo más importante, creemos que este compromiso vale la pena.

Lo que viene: Modo Historia

Aquí hay algo emocionante: estamos construyendo un nuevo Modo Historia que usa salida estructurada.

¿Por qué el enfoque diferente? El Modo Historia tiene diferentes prioridades:

- El control preciso de escena importa más que la creatividad libre

- Los metadatos ricos (ángulos de cámara, señales musicales, saltos de capítulo) agregan valor

- El formato es más predecible (estructura clara de capítulos/escenas)

- Los usuarios esperan una experiencia más "producida"

Diferentes casos de uso merecen diferentes arquitecturas. No somos dogmáticos sobre ningún enfoque único - elegimos lo que mejor sirve a los usuarios.

La verdad honesta

No hay solución perfecta para conversaciones de IA con múltiples personajes. Cada enfoque intercambia algo valioso por otra cosa.

¿Otras plataformas que muestran burbujas separadas? Probablemente están usando salida estructurada y aceptando sus limitaciones. ¿Plataformas con control de escena más "inteligente"? Probablemente llamadas a herramientas con mayores costos y latencia.

Elegimos el camino que prioriza lo que nuestros usuarios más valoran: roleplay grupal confiable, creativo y rentable.

La experiencia de burbujas separadas es agradable. Pero no a costa de todo lo demás.

Lo que estamos explorando

Estamos experimentando con enfoques híbridos:

- Parseo post-procesamiento: Usar modelos ligeros para dividir texto libre en segmentos de personajes después de la generación

- Modo estructurado opcional: Permitir a usuarios avanzados elegir salida estructurada cuando necesiten control preciso

- Detección inteligente de escenas: Identificar automáticamente puntos de quiebre naturales para mejor presentación de UI

El objetivo no es encontrar la respuesta "correcta". Es seguir mejorando la experiencia mientras mantenemos lo que funciona.

¿Tienes ideas sobre cómo debería funcionar el chat grupal? Nos encantaría escucharte.

¿Listo para experimentar conversaciones dinámicas con IA?

Únete a miles de usuarios que ya están explorando personalidades infinitas e interacciones atractivas en Reverie.